¿Quieres un SaaS con IA que sobreviva seis meses en producción o solo un demo viral de 48 horas?

Tiempo estimado de lectura: 5 min

- Ideas clave:

- La diferencia entre un demo viral y un SaaS real no es la idea ni el modelo, sino la arquitectura.

- Diseña asumiendo que la IA falla: latencia, rate limits y respuestas inconsistentes son inevitables.

- Separación clara de responsabilidades (frontend, backend, orquestador, workers, persistencia) y asincronía por defecto salvan proyectos.

- Contratos estrictos (JSON + validación) y observabilidad desde el inicio son imprescindibles para producción.

¿Quieres un SaaS con IA que sobreviva seis meses en producción o solo un demo viral de 48 horas?

La diferencia no es la idea ni el modelo que uses. Es la arquitectura. Y sí: la IA te hace sentir productivo en minutos. También te hace pagar por la reescritura en semanas.

Voy al grano. Si tu apuesta es “poner un prompt en un endpoint y ver qué pasa”, estás construyendo un wrapper, no un producto. Un wrapper se rompe cuando el proveedor cambia precios, cuando la latencia sube o cuando un caso borde que nunca imaginaste llega a producción. Un SaaS real convierte la IA en un componente confiable dentro de un sistema diseñado para fallar sin morir.

Aquí tienes un plan práctico y sin postureo para construir un SaaS real con IA sin improvisar.

Resumen rápido (lectores con prisa)

Qué es: Buenas prácticas de arquitectura para convertir modelos de IA en componentes fiables dentro de un SaaS.

Cuándo usarlo: Desde el MVP que pretende escalar hasta productos en producción con múltiples tenants y requisitos de coste y seguridad.

Por qué importa: Evita que un prototipo se convierta en deuda técnica cara y en incidentes de producción.

Cómo funciona, en pocas palabras: Separación de responsabilidades, asincronía por defecto, contratos estrictos (JSON + validación), observabilidad y pruebas que incluyan fallos de IA.

Primera regla: asume que la IA falla… constantemente

No es pesimismo. Es ingeniería. Latencia, rate limits, respuestas inconsistentes, cambios en la API: todo será parte de la vida diaria. Diseña para eso.

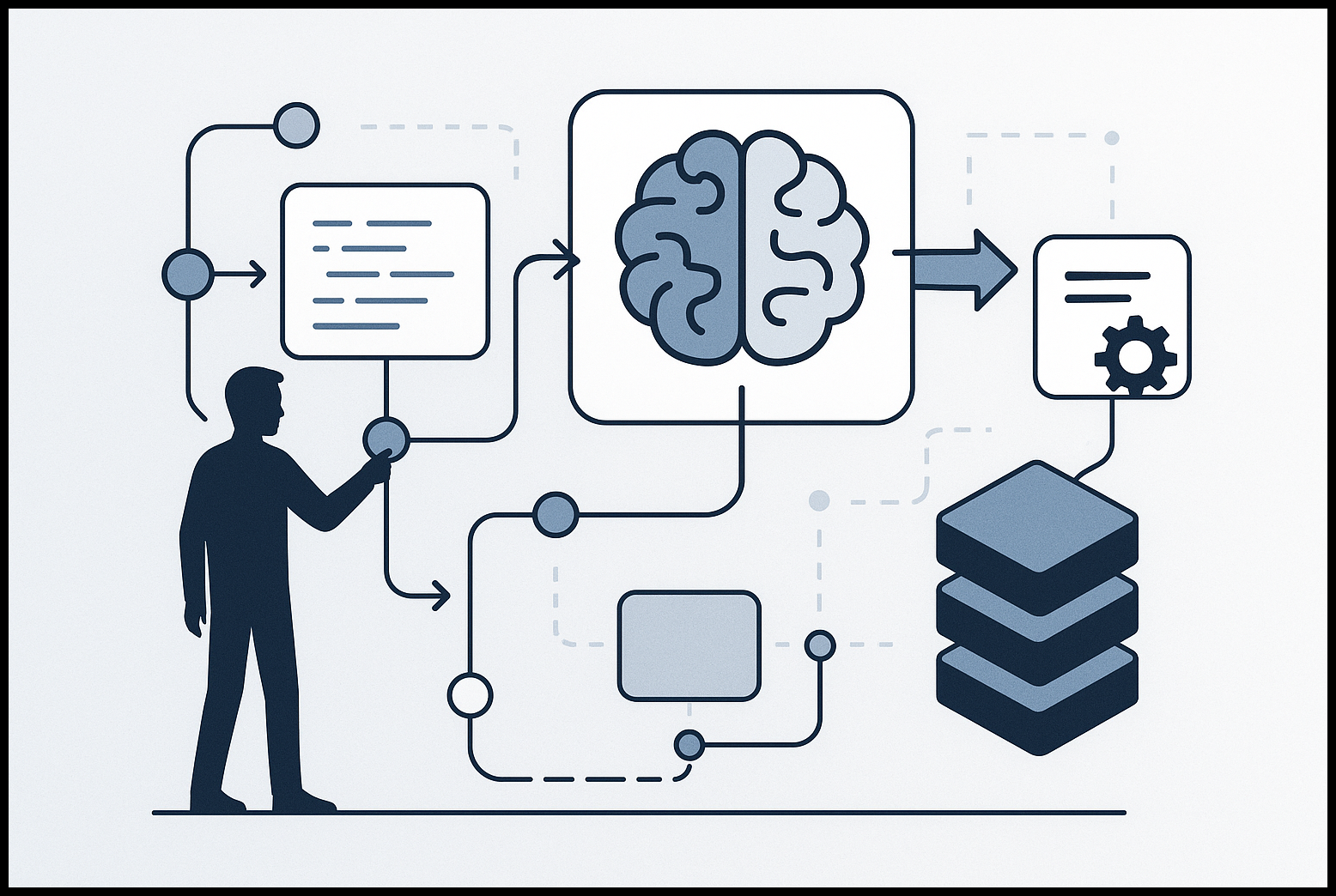

Qué separar desde el minuto uno

No mezcles interfaz, orquestación y persistencia. Divide responsabilidades claras:

- Frontend: experiencia, manejo de latencia, feedback al usuario.

- Backend de negocio: validaciones, reglas, monetización, seguridad.

- Orquestador de IA: flujos, reintentos, parsing y almacenamiento de resultados.

- Workers: procesamiento asíncrono, reintentos idempotentes.

- Persistence: PostgreSQL (con pgvector), logs, metadatos.

Si todo está en el mismo contenedor, el sistema se romperá bonito y rápido.

Patrón que salva proyectos: asincronía por defecto

Olvida la llamada síncrona “cliente→server→LLM→cliente”. Es la receta del timeout.

- Client envía tarea → server registra job (estado: pending) → responde 202.

- Worker (o n8n) toma job, hace llamadas a LLMs, actualiza estado.

- Notifica por WebSocket/SSE o el cliente hace polling leve.

Resultado: interfaz reactiva, control de reintentos y mejor experiencia cuando la IA tarda.

Orquestación: usa n8n, no code spaghetti

Sí, puedes encadenar prompts en código. También puedes terminar con funciones de mil líneas. Usa un orquestador (n8n o equivalente) para:

- Encadenar pasos (call LLM → transformación → persistencia).

- Ejecutar retries con backoff.

- Manejar errores y circuit breakers visualmente.

- Mantener logs de cada ejecución.

El día que la API de IA se ponga inestable, agradecerás no tener que rastrear todo en un repo lleno de lambdas.

Contratos > Prompts

No pidas “texto bonito”. Pide JSON estricto. No hay excusas.

- Define interfaces TypeScript o OpenAPI.

- Obliga a la IA a devolver un objeto con esquema verificado.

- Usa Zod o codegen para validar la respuesta y fallar rápido si hay desviaciones.

Esto convierte a la IA en un microservicio con contrato, no en una caja negra caprichosa.

RAG = potencia + responsabilidad

Si vas a permitir que usuarios suban documentos para chatear con ellos, aplica aislamiento absoluto:

- Cada vector con tenant_id.

- Filtrado por tenant_id a nivel de consulta (antes de enviar contexto al LLM).

- Escapa la tentación de “mezclar para mejores embeddings”. Eso rompe privacidad y compliance.

Si trabajas con datos sensibles, aíslalo, audítalo y documenta quién lo puede ver.

Costos y medición: que no te coja desprevenido

Un SaaS con IA vive o muere por el coste por petición.

- Metering por job: tokens consumidos, llamadas a terceros, tiempo de ejecución.

- Alerts por coste semanal y por job atípico.

- Fallbacks: versiones más baratas del modelo para tareas no críticas.

- Caching inteligente: respuestas deterministas pueden cachearse.

No hay nada más caro que ejecutar un modelo grande para una operación que podía resolverse con reglas.

Idempotencia y seguridad en flujos asíncronos

Reintentos inevitables → diseñalos bien:

- Usa IDs de correlación.

- Diseña workers idempotentes: reintentar no debe duplicar registros ni cobrar dos veces.

- Aplica locks por job cuando haga falta.

Observabilidad: telemetría desde el minuto cero

Si no puedes medir, no puedes mejorar. Instrumenta todo:

- Traces distribuidos (OpenTelemetry).

- Métricas por endpoint, por modelo y por tenant.

- Logs estructurados con contexto de job.

- Dashboards y alertas (latencia, error rates, coste por tenant).

Tests y contratos automáticos

Haz que cada contrato tenga tests que fallen en CI si la IA devuelve algo fuera de esquema.

- Mockea respuestas de LLM (positivas y negativas).

- Tests de integración que simulen timeouts y retries.

- Tests de seguridad: inyección de prompt, accesos cruzados entre tenants.

Checklist MVP vs. Producción

MVP mínimo viable (rápido, medible):

- Job queue + worker básico.

- Interfaces TypeScript + validación Zod.

- Persistencia en PostgreSQL + pgvector.

- Orquestación simple (n8n optional).

- Métricas básicas y alertas de coste.

Preparación para producción:

- Observabilidad completa (traces, metrics, logs).

- Políticas de multi-tenancy estrictas.

- Circuit breakers, retries con backoff y dead-letter queues.

- Billing y metering por tokens/calls.

- Testing de resiliencia y chaos experiments.

Plantilla rápida de SPEC.md que debes tener ya

Pon esto en la raíz del repo. Si no lo haces ahora, lo pagarás después.

- Objetivo del módulo (1 frase).

- Stack aprobado y versiones.

- Reglas innegociables (ej.: “No exponer secretos en frontend”, “Todo job idempotente”).

- Contratos principales: Endpoints + interfaces TS.

- Criterios de aceptación (tests que deben pasar).

- Responsable técnico y proceso de cambios.

Prompt maestro que funciona (ejemplo)

Contexto + restricciones + output estricto:

<contexto_negocio>Resumen en 3 frases</contexto_negocio>

<stack>Next.js, Node 20, Postgres + pgvector</stack>

<restricciones>No usar microservicios, respuesta JSON valida Zod</restricciones>

<output_esperado>JSON { result: string, score: number, metadata: { sourceId: string } }</output_esperado>

No es glamour. Es ingeniería que evita tickets nocturnos.

El nuevo rol del equipo: menos héroes, más guardias

Con IA el que más aporta no es el que teclea más rápido. Es el que fija límites, define contratos y establece el ritmo de iteración. El senior deja de ser “code god” para ser “arquitecto de fronteras”. Eso es lo que realmente escala.

CTA corto y útil

Si quieres, te doy ahora:

- Una SPEC.md lista para pegar en tu repo.

- Un prompt maestro para Claude + ejemplos de Zod.

- Un .n8n workflow básico para encadenar llamadas a modelos con retries.

Respóndeme con “Plantilla SaaS” y te lo envío. Hazlo ahora: crea el SPEC.md en la raíz antes del próximo commit generado por IA.

Dominicode Labs

Si quieres continuidad práctica y recursos relacionados con orquestación, workflows y automatización para productos de IA, visita Dominicode Labs. Es una continuación lógica para poner en práctica los enfoques descritos en este artículo.

FAQ

¿Por qué no debería hacer llamadas síncronas al LLM desde el cliente?

Porque los timeouts, latencias y rate limits hacen que la experiencia sea impredecible. La arquitectura asíncrona (jobs + workers) permite reintentos, control de costes y una interfaz más robusta.

¿Qué es un orquestador y por qué usar n8n?

Un orquestador encadena pasos: llamadas a LLM, transformaciones, persistencia y retries. n8n ofrece visualización de flujos, gestión de errores y menos código espagueti en repositorios complejos.

¿Cómo obligo a la IA a devolver JSON válido?

Define un contrato (TypeScript/OpenAPI) y valida con Zod u otro validador. Rechaza respuestas que no cumplan el esquema y trata esos casos en tus retries o dead-letter queues.

¿Qué medidas tomar para multi-tenancy en RAG?

Aislamiento absoluto: cada vector con tenant_id, filtrado por tenant_id antes de consultas y auditoría de accesos. No mezclar datos entre tenants.

¿Qué métricas debo medir desde el primer día?

Tokens consumidos por job, latencia por endpoint, error rate por modelo y coste por tenant. También traces distribuidos y logs estructurados por job.

¿Qué debe incluir mi SPEC.md mínimo?

Objetivo del módulo, stack y versiones, reglas innegociables, contratos principales (endpoints + interfaces TS), criterios de aceptación y responsable técnico.

Leave a Reply