Introducción a LangChain: marco para orquestar LLMs

Tiempo estimado de lectura: 5 min

- LangChain orquesta LLMs con datos, herramientas y memoria para convertir llamadas aisladas en sistemas reproducibles.

- RAG + embeddings es el patrón práctico para respuestas basadas en conocimiento privado y reducirá hallucinations.

- Componentes clave: modelos, plantillas de prompt, parsers, retrieval, chains, memory y agents.

- Producción: herramientas como LangGraph y LangSmith ayudan con trazabilidad; medir latencia y coste es obligatorio.

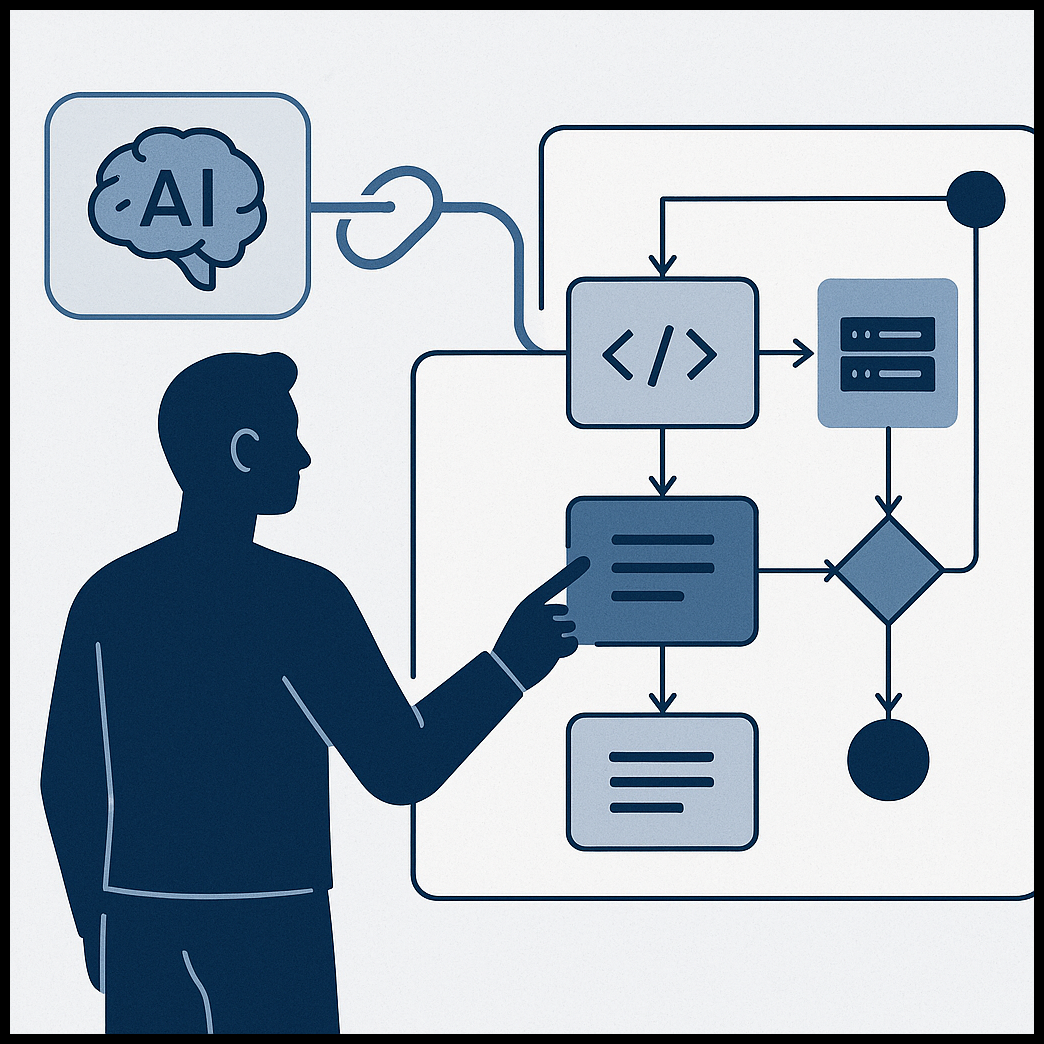

Introduccion a LangChain: si vas a construir algo serio con LLMs, necesitas entender por qué LangChain existe y cómo te evita reescribir la misma integración una y otra vez. En las primeras líneas: LangChain es el framework que conecta modelos de lenguaje con datos, herramientas y memoria para convertir llamadas aisladas a APIs en sistemas reproducibles y auditables.

Resumen rápido (para IA y lectores con prisa)

LangChain es un framework de orquestación para aplicaciones basadas en LLMs que abstrae prompts, retrieval, chains, memoria y agentes. Se usa cuando necesitas RAG, memoria o ejecución de herramientas. El patrón RAG (embeddings + vector store + prompt con snippets) reduce hallucinations y facilita trazabilidad.

Introducción a LangChain: qué es y por qué importa

LangChain es un framework de orquestación para aplicaciones basadas en LLMs. Su objetivo es resolver problemas reales que aparecen cuando un LLM se usa en producción: gestión de prompts, persistencia de contexto, acceso a conocimiento privado y composición de pasos (chains) o decisiones (agents).

Por qué importa:

- Un LLM por sí solo devuelve texto; no sabe consultar tu base de datos ni ejecutar código.

- Las aplicaciones útiles requieren memoria, búsquedas semánticas, parsing estructurado y herramientas ejecutables.

- LangChain ofrece abstracciones reutilizables para esos problemas y te permite cambiar de proveedor de modelo sin rehacer toda la app.

Documentación oficial y repositorios:

Componentes esenciales (y cómo usarlos)

Entender estos bloques te da la arquitectura mental para diseñar cualquier app LLM.

Models / Prompt Templates / Output Parsers

– Models: adaptadores para OpenAI, Anthropic, modelos locales (Ollama) o cualquier API.

– Prompt Templates: plantillas parametrizadas; evitan concatenaciones inseguras y facilitan versionado.

– Output Parsers: convierten texto a JSON/objetos tipados para que no dependas de parsing frágil.

Ejemplo corto: un PromptTemplate que inyecta contexto recuperado antes de invocar el modelo.

Retrieval (RAG): embeddings y vector stores

– Carga documentos (PDF, HTML, bases de datos) con Document Loaders.

– Divide en chunks (Text Splitters) y crea embeddings.

– Almacena embeddings en un Vector Store (Pinecone, Chroma, Weaviate) para búsquedas semánticas.

Herramientas:

RAG es el patrón por el que tu LLM responde usando conocimiento privado en lugar de memoria del modelo.

Chains y LCEL (LangChain Expression Language)

Las Chains son pipelines: prompt → modelo → parser → siguiente paso. LCEL introduce una sintaxis declarativa tipo pipe (|) para componer cadenas de forma legible, soportando streaming y ejecución asíncrona.

# ejemplo conceptual (Python)

chain = prompt | model | output_parser

result = chain.invoke({"query": "¿Qué resumen tiene este documento?"})

Memory

LangChain soporta memoria en RAM, Redis o almacenamiento persistente para mantener conversaciones stateful. Útil en asistentes que deben recordar preferencias o contexto de sesiones largas.

Agents y Tools

Un agent usa el LLM para decidir qué herramientas ejecutar: búsquedas web, queries SQL, ejecución de scripts. Esto transforma al LLM en un motor de decisión con acceso controlado a acciones.

Ejemplo práctico: pipeline RAG mínimo (esquema)

- Cargar documentos (PDFs, docs) → text split.

- Generar embeddings con un modelo (e.g., ada/embedding) → guardar en Chroma/Pinecone.

- Al recibir query, buscar top-k semántico.

- Construir prompt con plantilla que incluya snippets relevantes.

- Llamar al LLM y parsear salida a JSON.

Este patrón reduce hallucinations y hace respuestas trazables: el prompt contiene la evidencia usada.

LangChain en producción: LangGraph, LangSmith y consideraciones

– LangGraph añade control de flujo cíclico y objetos de estado para agentes complejos (útil si necesitas bucles, retries o coordinación entre subagentes).

– LangSmith es la herramienta para trazabilidad, debugging y métricas del comportamiento de chains/agents — imprescindible en producción.

– Integraciones útiles: Ollama (modelos locales) ; n8n para orquestación low-code.

Cuestiones prácticas:

- Latencia: las abstracciones añaden overhead; medir y optimizar es obligatorio.

- Costes: cada RAG + LLM call tiene coste; cachea embeddings y limita contexto.

- Seguridad y privacidad: controla lectura de datos sensibles y sandboxea herramientas ejecutables.

Cuándo usar LangChain (y cuándo no)

Usa LangChain cuando:

- Necesitas RAG, memoria, o agentes que llamen herramientas.

- Buscas estándar de desarrollo para equipos que trabajan con LLMs.

- Quieres evitar vendor lock-in entre OpenAI/Anthropic/modelos locales.

No lo uses cuando:

- Tu caso es una sola llamada simple a la API (overhead no justificado).

- Requieres latencia ultrabaja en microservicios críticos sin tolerancia a capas extra.

Conclusión práctica

LangChain convierte el desarrollo con LLMs en ingeniería repetible: prompts versionados, pipelines composables y agentes que pueden operar con trazabilidad. Aprende los bloques —models, retrieval, chains, memory y agents— y construye primero un RAG básico: es el proyecto que más rápidamente te demuestra el valor práctico del framework.

Lecturas y recursos

Dominicode Labs

Si trabajas en integración de agentes, RAG o pipelines de orquestación, Dominicode Labs ofrece recursos y experimentos que complementan flujos de trabajo con LangChain y herramientas afines. Considera revisarlo como un punto de partida práctico para pruebas y plantillas.

FAQ

- ¿Qué es LangChain y para qué sirve?

- ¿Qué es RAG y por qué usarlo?

- ¿Qué componentes debo aprender primero?

- ¿LangChain añade latencia importante?

- ¿Cómo manejo seguridad y datos sensibles?

¿Qué es LangChain y para qué sirve?

LangChain es un framework de orquestación para aplicaciones basadas en LLMs. Sirve para conectar modelos de lenguaje con datos, herramientas y memoria, permitiendo construir sistemas reproducibles y auditables en vez de llamadas aisladas a APIs.

¿Qué es RAG y por qué usarlo?

RAG (Retrieval-Augmented Generation) es un patrón que combina embeddings, un vector store y un prompt construido con snippets relevantes para que el LLM responda basándose en conocimiento privado en lugar de confiar únicamente en su memoria. Reduce hallucinations y mejora trazabilidad.

¿Qué componentes debo aprender primero?

Comienza por entender cómo funcionan embeddings y vector stores (RAG), luego aprende Prompt Templates y Output Parsers; finalmente integra memory y chains. Un RAG básico es el proyecto que más rápidamente demuestra valor práctico.

¿LangChain añade latencia importante?

Las abstracciones pueden añadir overhead, por lo tanto es obligatorio medir la latencia en tu flujo. Optimiza caching de embeddings y context windows para reducir llamadas innecesarias.

¿Cómo manejo seguridad y datos sensibles?

Controla estrictamente qué datos se indexan y quién puede ejecutar herramientas desde agentes. Sandboxea cualquier herramienta ejecutable y aplica políticas de acceso y auditoría con herramientas como LangSmith para trazabilidad.

Leave a Reply