De script a micro-SaaS: convertir código Python en un producto vendible

Tiempo estimado de lectura: 5 min

- Desacopla procesamiento pesado de los endpoints HTTP usando colas de tareas.

- Usa FastAPI + Celery + Redis como arquitectura mínima reproducible.

- Prioriza autenticación, límites y facturación antes de añadir features.

Tabla de contenidos

- Título

- Resumen rápido (lectores con prisa)

- De script a micro-SaaS: arquitectura mínima y por qué importa

- Stack recomendado

- Flujo básico

- Código mínimo: entrada, worker y status

- Autenticación, límites y monetización

- API Keys

- Rate limiting

- Facturación básica

- Deploy rápido y operaciones

- Monitoreo y operativa

- Plataformas PaaS recomendadas

- Primeras tácticas de crecimiento y validación

- Criterio final: qué priorizar en las primeras semanas

- Dominicode Labs

- FAQ

- ¿Por qué desacoplar tareas largas de los endpoints?

- ¿Qué aporta FastAPI en este stack?

- ¿Cómo emito API Keys tras un pago?

- ¿Qué debo monitorizar inicialmente?

- ¿Es suficiente Docker Compose para producción?

“De script a micro-SaaS: convertir código Python en un producto vendible” no es un titular bonito: es la ruta práctica que separa un hobby útil de un servicio que paga facturas. Si tu script hace algo que otros necesitan —OCR, scraping, normalización de datos, generación de insights— puedes empaquetarlo, protegerlo y venderlo. Aquí tienes la arquitectura mínima, ejemplos y criterios para pasar de prototipo a producto real.

Resumen rápido (lectores con prisa)

Qué es: Un patrón para transformar scripts Python en un servicio con API, cola de tareas y facturación.

Cuándo usarlo: Cuando tus tareas son largas o requieren recursos y vas a exponerlas vía API.

Por qué importa: Evita timeouts y trabajadores bloqueados, habilita control de cuota y facturación.

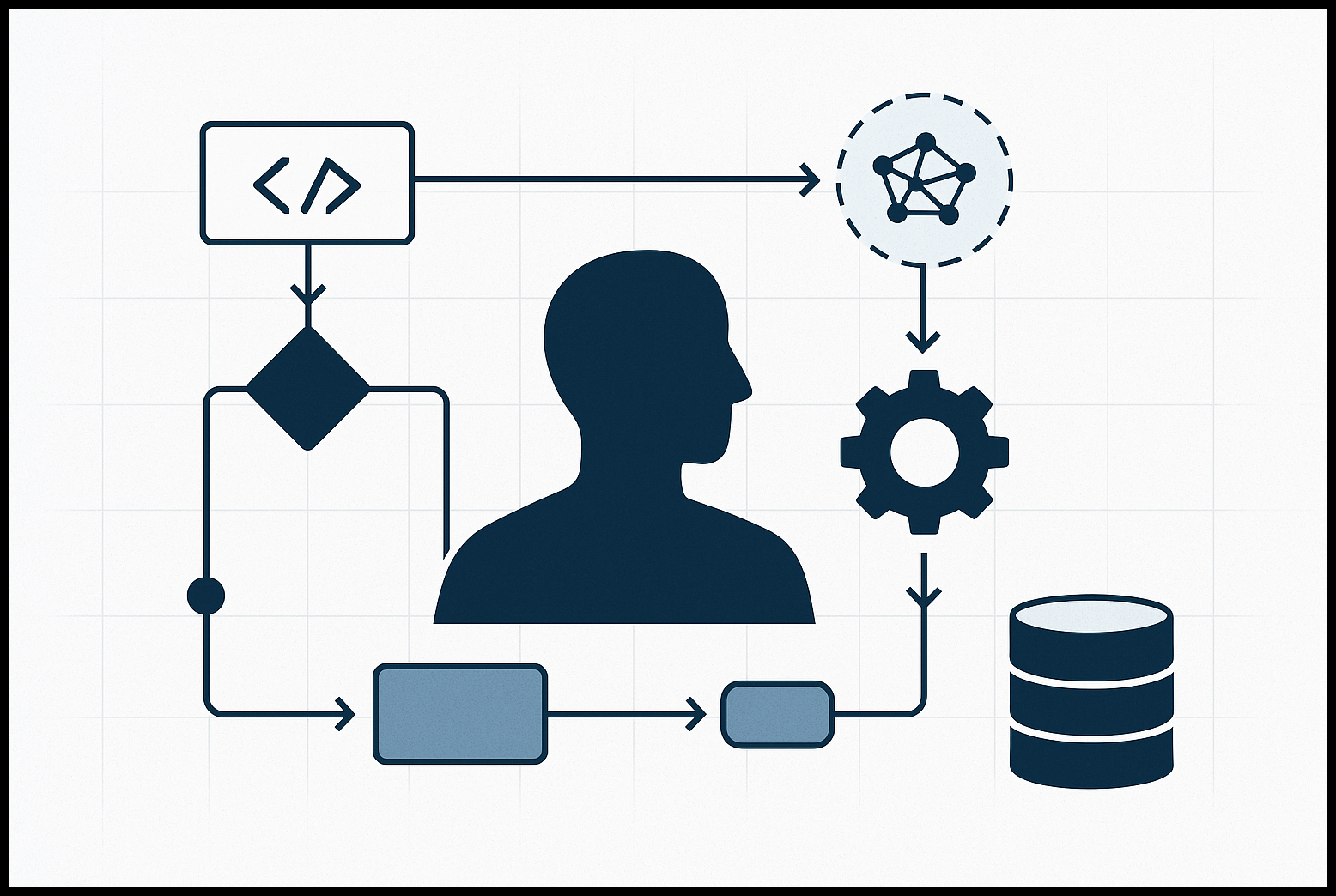

Cómo funciona: FastAPI recibe la petición y encola un job en Celery/Redis; un worker procesa y guarda resultados.

De script a micro-SaaS: arquitectura mínima y por qué importa

Stack recomendado

Flujo básico

- Cliente POST /jobs → recibe 202 y job_id.

- FastAPI encola tarea en Redis/Celery.

- Worker procesa en background y guarda resultado.

- Cliente GET /jobs/{id} consulta estado/resultado.

Código mínimo: entrada, worker y status

FastAPI encola; Celery procesa. Ejemplo mínimo ilustrativo:

# main.py (FastAPI)

from fastapi import FastAPI

from pydantic import BaseModel, HttpUrl

from worker import run_task

app = FastAPI()

class JobRequest(BaseModel):

source_url: HttpUrl

@app.post("/jobs", status_code=202)

async def create_job(req: JobRequest):

task = run_task.delay(str(req.source_url))

return {"job_id": task.id}# worker.py (Celery)

from celery import Celery

from my_script import process_url

celery_app = Celery("app", broker="redis://redis:6379/0", backend="redis://redis:6379/0")

@celery_app.task(acks_late=True)

def run_task(url):

return process_url(url)Endpoint de status usa AsyncResult de Celery para devolver estado y resultado.

Autenticación, límites y monetización

Un micro-SaaS no es solo código: es quien paga por usarlo. Implementa tres capas mínimas:

1. API Keys

Header X-API-KEY validado contra tu base de datos (o Supabase). Emite y revoca keys vinculadas a facturación y cuotas.

2. Rate limiting

Usa Redis + slowapi o fastapi-limiter para imponer cuotas por key.

3. Facturación básica

Integra Stripe para generar suscripciones y emitir API Keys tras pago. Un webhook puede crear la key y enviarla por correo. Payment Links + webhook de entrega de key son suficientes al inicio.

- Freemium: N jobs/mes gratis (onboarding).

- Pro: precio fijo + cuota de jobs.

- Enterprise: acuerdos, SLA y keys con prioridad en la cola.

Deploy rápido y operaciones

Conteneriza todo y usa Docker Compose para desarrollo y pruebas; despliega en PaaS para producción (Railway, Render, DigitalOcean). Un archivo docker-compose mínimo facilita reproducibilidad y onboarding de colaboradores.

Monitoreo y operativa

- Logging estructurado (python logging o structlog).

- Retries y

soft_time_limiten Celery para evitar jobs colgados. - Métricas: exporta métricas básicas (queue length, job duration) a Prometheus/Grafana.

- Persistencia: guarda metadatos de jobs y uso de clientes en PostgreSQL para facturación y auditoría.

Plataformas PaaS recomendadas

Primeras tácticas de crecimiento y validación

- Publica documentación técnica y una colección de ejemplos: FastAPI genera Swagger en

/docsautomáticamente — úsalo como demo. - Ofrece una integración de ejemplo con n8n para flujos no-code y demuestra cómo tu API entra en workflows.

- Lanza con precio bajo y limita uso para forzar upgrades; monitoriza conversiones y tiempo hasta el primer pago.

- Usa canales técnicos (IndieHackers, Hacker News, Reddit r/SaaS) y aporta un caso de uso concreto en el post (ej. OCR a $0.01/página).

Criterio final: qué priorizar en las primeras semanas

- Desacoplar (FastAPI + Celery).

- Validación y seguridad (Pydantic + API Keys).

- Observabilidad (logs + métricas).

- Un onboarding que convierta (docs + demo + pago simple).

Convertir un script en micro-SaaS es ingeniería, no marketing. Si tu servicio resuelve un problema real, empaquetarlo con esta arquitectura te permite cobrar por cada petición sin romperte la espalda. Empieza por un endpoint, una cola y una suscripción: si la gente paga, escala; si no, iteras rápido.

Dominicode Labs

Si te interesa continuar con prototipos, integraciones no-code y flujos de automatización, considera explorar recursos y experimentos en Dominicode Labs. Es una continuación natural para validar integraciones y ejemplos técnicos antes de escalar.

FAQ

¿Por qué desacoplar tareas largas de los endpoints?

Las tareas largas (10–60 segundos) provocan timeouts y pueden bloquear workers si se ejecutan en peticiones síncronas. Desacoplar mediante una cola evita estos problemas y mejora la disponibilidad del servicio.

¿Qué aporta FastAPI en este stack?

FastAPI proporciona un framework ligero para exponer endpoints HTTP con validación de entrada mediante Pydantic y documentación automática en /docs. Facilita la construcción de APIs robustas y bien tipadas.

¿Cómo emito API Keys tras un pago?

Usa Stripe Checkout o Payment Links. Configura un webhook que escuche eventos de pago y, al confirmar la suscripción, genere y almacene la API Key asociada al cliente.

¿Qué debo monitorizar inicialmente?

Comienza con logs estructurados, longitud de cola, duración de jobs y errores. Exporta métricas a Prometheus y visualízalas en Grafana para detectar cuellos de botella y patrones de fallo.

¿Es suficiente Docker Compose para producción?

Docker Compose es suficiente para desarrollo y pruebas reproducibles. Para producción conviene desplegar en un PaaS o usar orquestadores con escalado y alta disponibilidad; las PaaS sugeridas facilitan arrancar rápido.

Leave a Reply