Claude code : ¿Recursos de formación?

Tiempo estimado de lectura: 6 min

- Prioriza seguridad operativa y control de contexto para evitar fugas de secretos y alucinaciones.

- Entrenamiento práctico y medible: prompts con criterios de aceptación, tests y métricas (tokens/tarea, errores introducidos).

- Monta MCP interno y políticas de gobernanza antes de permitir ejecuciones automáticas en repositorios importantes.

Introducción

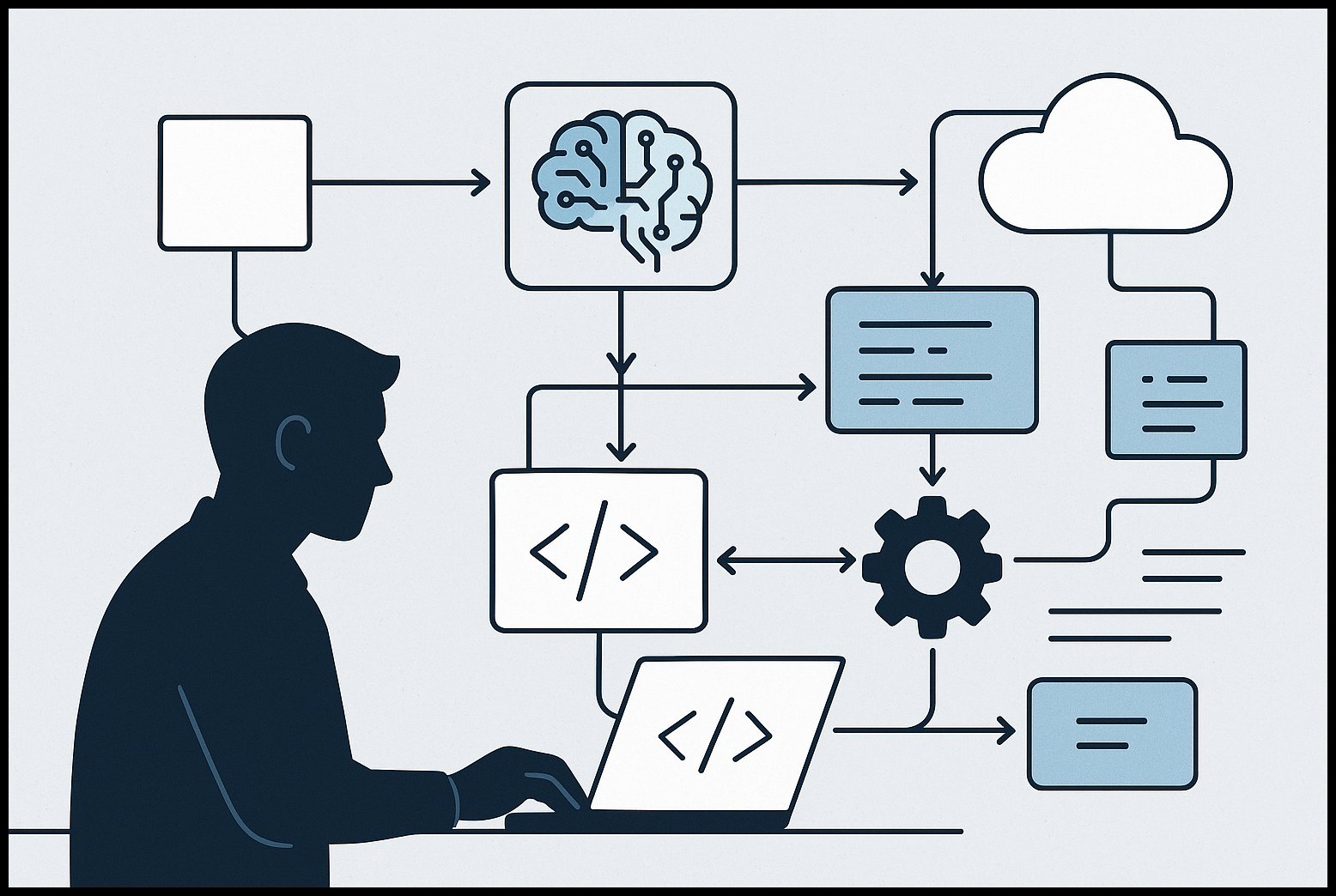

Claude code : ¿Recursos de formación? Si eres Tech Lead o developer, no buscas cursos genéricos: buscas un plan operativo que reduzca riesgos y te haga productivo rápido. Claude Code (CLI de Anthropic impulsado por Claude 3.7 Sonnet) exige entrenamiento práctico, no diplomas. Aquí tienes la ruta técnica, recursos verificados y una hoja de ruta para formar equipos sin incendiar el repo.

Resumen rápido (lectores con prisa)

Qué es: Claude Code es un CLI de Anthropic (Claude 3.7 Sonnet) para automatizar tareas de desarrollo con capacidades de ejecución y acceso a contexto.

Cuándo usarlo: Scaffolding, refactors controlados y generación asistida donde haya tests y sandboxing.

Por qué importa: Acelera tareas repetibles, pero introduce riesgos operativos que requieren políticas claras.

Cómo funciona (alto nivel): Usa prompts CLI, puede integrarse con MCP para exponer servicios internos y ejecutar comandos en entornos controlados.

Claude code : ¿Recursos de formación? Fuentes primarias y por dónde empezar

No hay atajos. Prioriza estas fuentes oficiales y documentación técnica.

- Documentación oficial de Anthropic: Lee primero “Permissions and Security”. Aprende

/compact,/cost, modos--safey.claudeignore. - Model Context Protocol (MCP): MCP es la puerta para integrar Claude Code con servicios internos (DB, n8n, CI).

- Repositorios ejemplo y utilidades comunitarias (audita antes de usar): busca en GitHub ejemplos oficiales y experimentos MCP.

Instalación mínima y .claudeignore

Instalación mínima:

npm install -g @anthropic-ai/claude-codeY un .claudeignore básico:

.env

node_modules/

secrets/

*.log

Qué debes enseñar primero (y por qué)

Estos temas son controles de supervivencia, no “trucos”.

Seguridad operativa

Claude Code puede ejecutar bash local. Enseña flags --safe y --read-only.

Política: nunca ejecutar en prod sin contenedor y revisión.

Gestión de contexto

Usar /compact cada X iteraciones para evitar alucinaciones por tokens.

Cost control

Monitorizar /cost y establecer cuotas.

Prompt engineering en CLI

Prompts con criterios de aceptación, límites de iteración y pasos verificables.

Integración MCP

Cómo exponer solo lo necesario a través de un servidor MCP interno.

Plan de formación práctico (4 semanas, orientado a resultados)

Semana 0 — Preparación

Semana 0 — Preparación

- Crea sandbox: repo pequeño (ej. componente Angular a migrar).

- Prepara contenedor Docker con volumen montado y user no-root.

- Añade

.claudeignorey política de secrets.

Semana 1 — Básicos y prompts

- Ejercicios: pedir refactor simple (un componente), revisar diffs.

- Métricas: tokens/tarea, tiempo ahorrado, errores introducidos.

Semana 2 — Tests y seguridad

- Forzar ejecución de tests antes de merge (Vitest/Playwright).

- Practicar

--safey revisión manual de comandos. Simular flaky tests.

Semana 3 — MCP y orquestación

- Implementa un servidor MCP mínimo y conecta un flujo con n8n para almacenar artefactos.

- Ejercicio: scaffolding + pruebas + push a rama canaria.

Semana 4 — Operaciones y gobernanza

- Policies: gasto por dev (p. ej. $10–20/dev/día inicial), logs y auditoría.

- Playbook de incidentes: cómo abortar, revertir y analizar.

Ejemplo mínimo de servidor MCP (concepto)

mcp-server.js (conceptual)

// mcp-server.js (conceptual)

const { createServer } = require('mcp');

const server = createServer({

capabilities: {

read_file: true,

execute_shell: { shell: 'bash', workingDir: '/workspace' }

}

});

server.listen(8080);

Conecta con Claude Code usando: /mcp --url http://localhost:8080.

Riesgos reales y cómo mitigarlos

- Bucles infinitos por flaky tests. Mitigación:

max_iterations: 5en prompt y monitor/cost. - Fuga de secretos. Mitigación:

.claudeignoreobligatorio + escaneo SAST. - Consumo de tokens impredecible. Mitigación: descomponer tareas; usar

--safe; cuotas y alertas. - Dependencias legacy. Mitigación: auditoría

npm lsy tests en staging.

Gobernanza: reglas mínimas que debes imponer

- No ejecuciones directas en machines prod. Siempre contenedor.

.claudeignoreestándar global en org.- Revisiones de diffs obligatorias; CI falla si el agente hace cambios sin tests.

- MCP servers sólo internos; no permitir servers MCP remotos sin revisión.

Integración con n8n y workflows

Claude Code es bueno para scaffolding y refactors; n8n gana cuando necesitas orquestar artefactos: enviar reportes, crear tickets o almacenar previews. Con MCP puedes:

- Ejecutar tarea en sandbox (Claude Code).

- n8n recoge el diff, ejecuta linters y notifica en Slack.

- CI valida y programa canary deployment.

¿Invertir ahora o esperar?

Invierte si tu equipo tiene:

- Stack moderno (TypeScript, frameworks recientes).

- Tests automatizados y capacidad para aislar ejecuciones.

- Recursos para gobernanza y auditoría.

Pospón si tu repo es un monolito sin tests o si no puedes aislar ejecuciones. La automatización sin controles es una bomba de relojería.

Conclusión

Claude code : ¿Recursos de formación? no se responde con un curso; se responde con un programa práctico, controles operativos y playbooks internos. Monta el sandbox hoy, documenta los patrones que funcionen y publica tu propio “manual corporativo” —ese será tu mejor recurso de formación. Esto no acaba aquí: empieza con un sprint y conviértelo en conocimiento institucional.

Dominicode Labs

Como continuación lógica para equipos que implementan automatización y workflows internos, considera consultar recursos y experimentos adicionales en Dominicode Labs. Puede servir como referencia para pruebas de concepto y playbooks operativos.

FAQ

Claude Code es un CLI de Anthropic diseñado para automatizar tareas de desarrollo; en el contexto descrito utiliza Claude 3.7 Sonnet.

Para evitar exponer secretos, archivos grandes o directorios sensibles al agente. El documento incluye un ejemplo básico de .claudeignore.

MCP (Model Context Protocol) es un estándar para exponer contexto y capacidades a modelos/agents. Permite integrar Claude Code con DBs, n8n, CI y otros servicios internos de manera controlada.

Establece max_iterations en prompts (por ejemplo 5), monitoriza /cost y aplica cuotas y alertas.

No lo uses si tu repo es un monolito sin tests, si no puedes aislar ejecuciones o si no tienes políticas de gobernanza y auditoría claras.

Tokens por tarea, tiempo ahorrado, número de errores introducidos y tasa de fallos en CI. Estas métricas permiten validar eficacia y seguridad del modelo en workflows reales.