Model Context Engineering (MCE) y Gestión Estratégica del Contexto

Tiempo estimado de lectura: 6 min

- El contexto es un recurso limitado: jerarquizar, comprimir y presupuestar reduce coste, latencia y errores.

- Arquitectura de prompt: usar una pila estratificada (system → examples → RAG → memoria → query) condiciona la atención del modelo.

- Compresión selectiva: extracción, resumen controlado y filtrado por perplejidad reducen tokens sin perder recall.

- Memoria híbrida: combinar vector DB y estado por entidad evita reinyectar todo el historial.

- Métricas y budgets: definir límites de tokens por sección y medir Context Efficiency Ratio.

Introducción

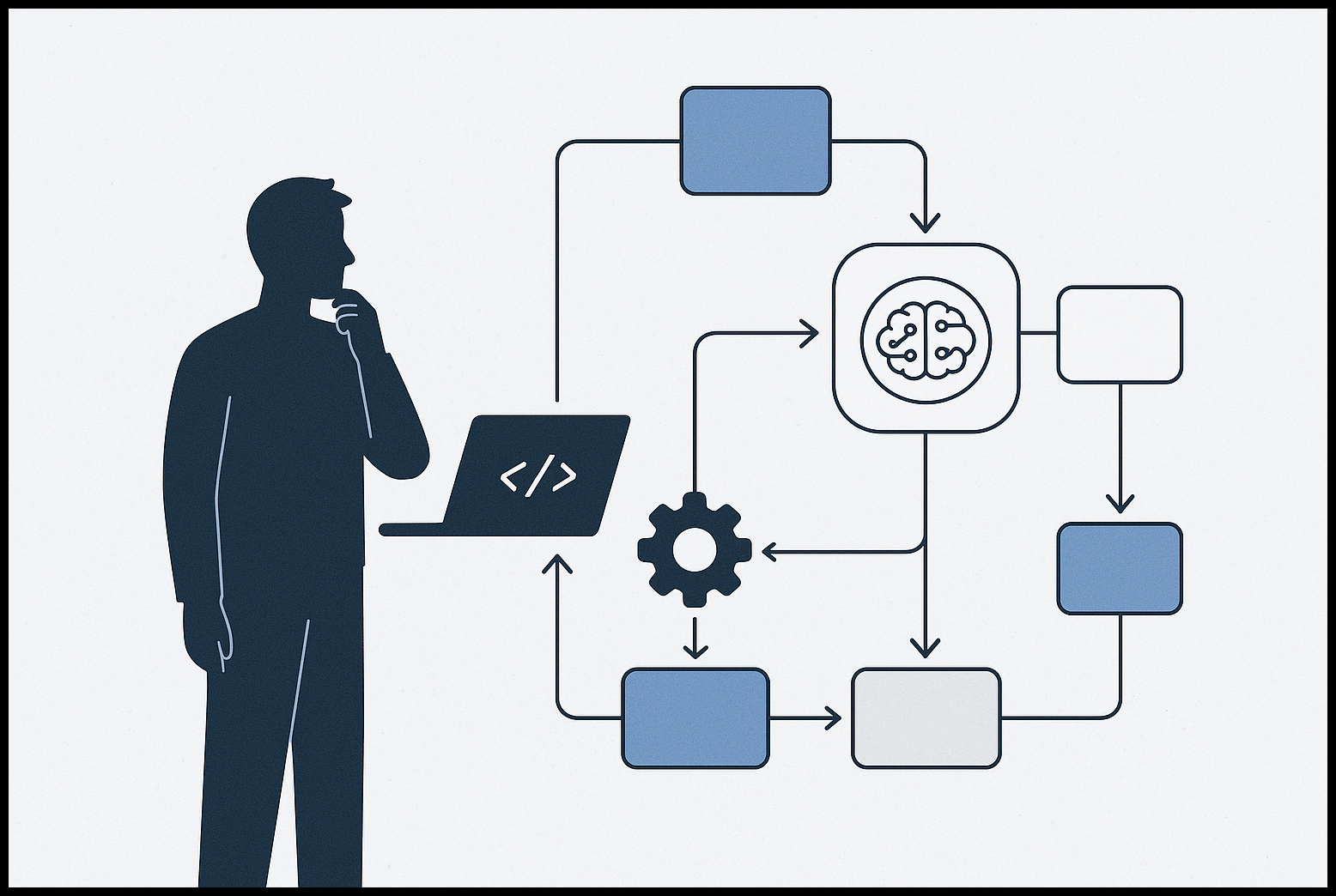

Model Context Engineering (MCE) y Gestión Estratégica del Contexto no es un lujo: es la pieza de arquitectura que decide si tu sistema LLM es sostenible en producción. Si RAG resuelve “dónde buscar”, MCE responde “qué entra, en qué orden, con qué prioridad y con qué compresión”. Ignorar eso es pedir al modelo que adivine entre basura.

Resumen rápido (lectores con prisa)

MCE es la práctica de tratar el contexto como un recurso limitado: definir orden, prioridad y compresión. Úsalo cuando los LLMs tengan ventanas de atención finitas o costos/latencias crecientes. Importa porque reduce coste, latencia y errores por pérdida en mitad del contexto. Funciona mediante una pila estratificada de inyección y pasos de compresión y re-ranking.

Model Context Engineering (MCE) y Gestión Estratégica del Contexto

Los LLMs funcionan con ventanas de atención finitas y sesgos de prioridad (primacy/recency). Meter todo el histórico, todos los documentos y todos los metadatos en cada request produce tres problemas prácticos: coste descontrolado, latencia insoportable y degradación de calidad (lost-in-the-middle). MCE transforma el contexto en un recurso gestionado: jerarquizado, presupuestado y comprimido.

Arquitectura de contexto: una topología práctica

Diseña el prompt como una pila estratificada con límites claros:

System instructions (inicio absoluto)

rol, seguridad, límites. Concisas.

Few-shot examples (si aplican)

formatos y patrones (JSON, schema).

Dynamic knowledge (RAG)

fragments re-ranked y etiquetados (<context>…</context>).

Conversation state

memoria comprimida o vectores relevantes.

User query (final absoluto)

Colocar elementos en ese orden no es estética: condiciona la atención del modelo. Etiqueta bloques para evitar contaminación de instrucciones y reduce la superficie de prompt-injection.

Estrategias de compresión y selección (prácticas)

No todo se resume igual. Usa una jerarquía de técnicas según criticidad:

- Extraction first: para datos concretos (IDs, fechas, pasos firmes), extrae y pasa solo esos hechos.

- Summarization controlled: para hilos largos o documentos, resume con un modelo económico antes de inyectar.

- Selective context (perplejity filtering): aplica un modelo pequeño para medir la aportación informativa de fragmentos y eliminar redundancia (ver LLMLingua).

- Hybrid: combina extracción + resumido para mantener citas clave sin ruido.

Aplica HyDE / hypothetical answer embeddings en búsquedas para mejorar recall sin aumentar tokens.

Memoria dinámica: patrones operativos

Diferencia clara entre almacenamiento (vector DB) y memoria de trabajo (contexto inyectado).

- Sliding window: simple y rápido; usa para chats cortos.

- Vectorized memory: indexa historial y recupera solo lo relevante por query.

- Entity memory (state object): mantén un JSON con estado del usuario/cliente y reinyéctalo; evita re-parsear conversaciones largas.

Combina vectorized memory con entity state para que los agentes (n8n / LangChain) mantengan objetivos sin reenviar todo el chat.

Presupuestos de tokens y KPIs

Define budgets por sección y métricas operativas:

- System: ≤ 500 tokens

- RAG context: ≤ 2.000 tokens (Top-5 chunks)

- History: ≤ 1.000 tokens (resumido)

- Output reserve: 300–500 tokens

Mide Context Efficiency Ratio = tokens_in / useful_tokens_out. Si ratio > 10, recorta. Controla coste por request (tokens * precio/modelo) y TTFT para SLAs.

Pipeline mínimo recomendable (implementable)

- Query rewrite (pequeño LLM) — convierte ambigüedades.

- Retrieval híbrido + re-ranking (BM25 + embeddings; rerank con cross-encoder). Ver Pinecone hybrid y LangChain parent retriever.

- Compression step (summarize/extract/select).

- Inject via ordered template (system → examples → compressed context → history → query).

- Post-check: schema validation, citation check, safety guardrails.

- Telemetry: trace cada etapa (LangSmith, LangFuse) y correlate con infra (OpenTelemetry: https://opentelemetry.io/).

Criterio para decisiones de ingeniería

No implementes todas las técnicas a la vez. Mide antes y después:

- Añade compresión si tokens por response > budget.

- Añade re-ranking si la tasa de hallucination o ruido supera X%.

- Mantén entity-state si repetición de información es alta.

- Prioriza cambios que reduzcan tokens necesarios sin pérdida de recall.

Herramientas útiles

LLMLingua (compresión), LangChain/ParentDocumentRetriever (jerarquía), Pinecone/ES para retrieval híbrido, LangSmith/LangFuse para observability.

Conclusión operativa

Model Context Engineering es la disciplina que convierte prompts en ingeniería predecible: reduce costes, baja latencia y mejora precisión. Trata el contexto como un recurso limitado: jerarquiza, comprime y presupuesta. Empieza por auditar tokens por flujo, define budgets y añade compactadores en el pipeline. No es glamour; es lo que separa demos que suenan bien de sistemas que funcionan y se mantienen. Esto no acaba aquí: MCE es un bucle continuo de medición, ajuste y versionado.

Dominicode Labs

Para equipos que implementan pipelines de MCE y observabilidad, puede ser útil consultar recursos prácticos y experimentos en Dominicode Labs. Está planteado como una continuación lógica para validar patrones de compresión y telemetry.

FAQ

- ¿Qué es Model Context Engineering (MCE)?

- ¿Cuándo debo aplicar compresión de contexto?

- ¿Cómo se mide la eficiencia del contexto?

- ¿Qué diferencia hay entre vector DB y memoria de trabajo?

- ¿Qué pasos incluye un pipeline mínimo de MCE?

- ¿Cuáles son los budgets recomendados por sección?

- ¿Qué herramientas recomiendan para retrieval híbrido?

MCE es la práctica de diseñar y gestionar qué contexto se inyecta en un modelo, en qué orden, con qué prioridad y con qué compresión, tratando el contexto como un recurso limitado para producción.

Aplica compresión cuando la ventana de tokens se acerque al límite, el coste/latencia crezca o cuando haya degradación por información irrelevante (lost-in-the-middle).

Usa Context Efficiency Ratio = tokens_in / useful_tokens_out y controla coste por request (tokens * precio/modelo) y TTFT para SLAs.

Vector DB almacena y recupera historial e índices para búsquedas; memoria de trabajo es lo que realmente se inyecta en cada request (contexto comprimido o estado por entidad).

Query rewrite → retrieval híbrido + re-ranking → compresión (summarize/extract/select) → inyección ordenada → post-check (schema/citas/seguridad) → telemetry.

System ≤ 500 tokens; RAG context ≤ 2.000 tokens (Top-5 chunks); History ≤ 1.000 tokens (resumido); Output reserve 300–500 tokens.

Recomendado combinar BM25 + embeddings y re-ranker cross-encoder. Referencias útiles: Pinecone hybrid y LangChain parent retriever.

Leave a Reply