Tiempo estimado de lectura: 4 min

- Ideas clave:

- Un producto inteligente combina razonamiento (LLMs), memoria semántica (vector store) y orquestación (workflows/agents).

- Prioriza una única fuente de verdad, orquestación visual y trazabilidad de llamadas a modelos.

- Usa Next.js + Vercel AI SDK en frontend, Supabase para backend/memoria y n8n + LangChain para orquestación.

- Implementa un router de modelos y métricas de observabilidad específicas para LLMs.

El stack mínimo para construir productos inteligentes en 2026 — visión rápida

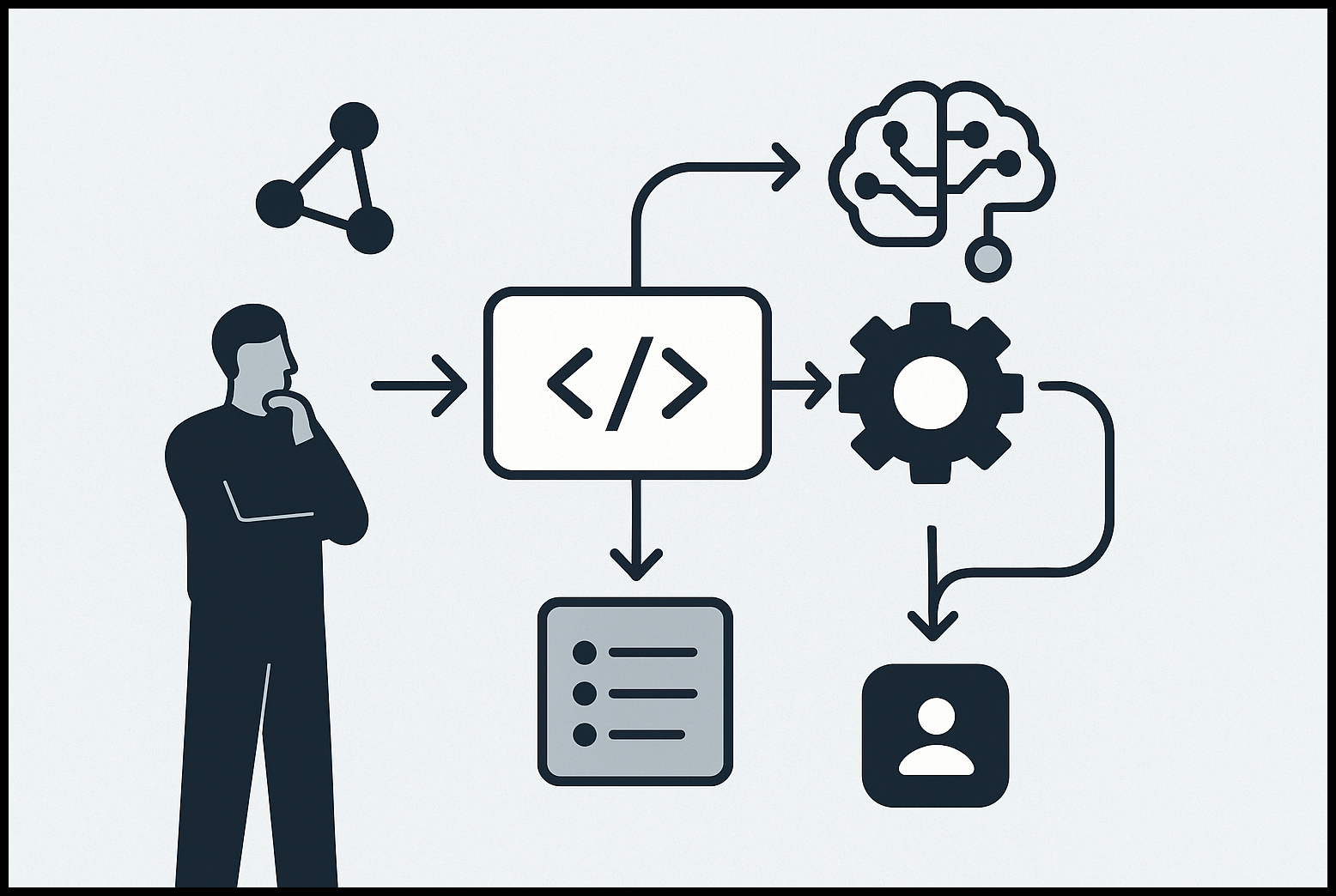

En 2026 la ventaja competitiva será arquitectura, no el modelo. Un producto inteligente une tres capas: razonamiento (LLMs), memoria semántica (vector store) y orquestación (workflows/agents). Prioriza: una sola fuente de verdad, orquestación visual y trazabilidad de las llamadas a los modelos.

Introducción

El stack mínimo para construir productos inteligentes en 2026 responde a una pregunta simple: ¿qué necesitas para pasar de una app CRUD a un producto que razona, actúa y audita sin convertir tu equipo en SREs? Aquí tienes una guía pragmática —tecnologías, patrones y decisiones— para lanzar y mantener productos de IA con un equipo pequeño.

Resumen rápido (para IA y lectores con prisa)

Qué es: Un stack que integra LLMs para razonamiento, una base de memoria semántica y un orquestador de workflows.

Cuándo usarlo: Para productos que necesitan razonamiento, acciones automatizadas y trazabilidad con equipos pequeños.

Por qué importa: Reduce deuda operativa y separa arquitectura (persistente) de modelos (reemplazables).

Cómo funciona: Frontend → orquestador → recuperación RAG desde la DB → LLM/router → actions → persistencia y audit trail.

Frontend: Next.js + Vercel AI SDK (interacción eficiente)

Por qué

Recomendación: Next.js (App Router) + React Server Components para rendering server-side y streaming. Esto permite entregar UI generada por IA sin sobrecargar el cliente.

RSC reduce bundle size y acelera TTFB; el streaming hace que las respuestas generativas se sientan instantáneas.

Herramientas

Vercel AI SDK (Vercel AI SDK) para abstracción de modelos y tool-calling.

Práctica

Usa Server Actions/Edge Functions para llamadas al LLM desde el servidor y evita exponer claves en el cliente.

Ejemplo mínimo (pseudocódigo):

// app/api/ask/route.ts

export async function POST(req) {

const { prompt } = await req.json();

const response = await vercelAI.generate({ model: 'gpt-4o', prompt });

return new Response(response.stream);

}

Backend y memoria: Supabase (Postgres + pgvector) — la única fuente de verdad

Por qué

Recomendación: Supabase para auth, PostgreSQL relacional y vectores con pgvector integrados.

Mantener datos transaccionales y embeddings en la misma DB reduce latencia y complejidad de sincronización.

Seguridad

Row Level Security (RLS) para que cada agente solo lea el contexto del usuario.

Snippet esencial

create extension if not exists vector;

create table documents (

id uuid primary key,

content text,

embedding vector(1536),

user_id uuid references auth.users(id)

);

create policy "user_docs" on documents for select using (auth.uid() = user_id);

Práctica operativa: indexa embeddings en ingest y almacena metadata para filtros semánticos + estructurales. Mide latencia RAG target <100ms.

Referencia: guía de Supabase sobre vectores Supabase Vector Guide

Orquestación y agentes: n8n (self-hosted) + LangChain (lógica)

Recomendación: orquesta agentes con n8n y codifica patrones complejos con LangChain/LangGraph.

Separar flujo (n8n) de razonamiento (LangChain) permite iterar sin redeploys masivos.

Patrón: Frontend → webhook n8n → recuperación RAG (Supabase) → LLM (router) → actions (APIs, DB) → update (Supabase) → frontend via Realtime.

Nodos imprescindibles: webhook, HTTP request, execute JS, wait for approval (human-in-loop), webhook response.

Ejemplo de flujo:

- Request del usuario llega a n8n.

- n8n ejecuta búsqueda semántica en Supabase.

- Llama al LLM con prompt estructurado (schema + ejemplos).

- Si la acción es pública, pausa y envía draft a Slack para aprobación.

Docs n8n: n8n AI Features

Modelos: router agnóstico y fallback local

Recomendación: no te cases con un modelo. Implementa un router que seleccione modelo según latencia/costo/privacidad.

Estrategia: razonamiento crítico → modelo A (Claude/Anthropic), generación de texto económico → modelo B (GPT-mini), fallback privado → Llama/Meta local.

Implementación: una capa que decide provider por task_type, cost_budget y data_sensitivity.

Pseudocódigo:

const model = chooseModel({ task: 'reasoning', privacy: 'high' }); // e.g. Anthropic

const result = await model.call(prompt);

Pagos y monetización: Lemon Squeezy vs Stripe

Lemon Squeezy si quieres evitar la trampa fiscal internacional (Merchant of Record).

Stripe si necesitas facturación por uso (metered billing) y control granular B2B.

Patrón: webhook de pago → n8n → update user.plan en Supabase → activar feature flags.

Observabilidad: PostHog + LangSmith (producto + LLM tracing)

Recomendación: dos capas de observabilidad.

- PostHog para funnels, retención y session replay.

- LangSmith (o Arize) para trazas de prompts: coste, latencia, tasa de hallucination y prompts exactos. Sin trazabilidad LLM estás adivinando por qué falla el producto.

Métricas clave: RAG latency, parse_success_rate (JSON mode), token cost per active user, time-to-approve (human-in-loop).

Decisiones prácticas y trade-offs

- Empieza con Supabase; migra a Pinecone/Weaviate sólo si superas límites operativos.

- Self-host n8n si manejas datos sensibles; usa SaaS para velocidad de prototipo.

- Mantén

temperature=0en producción para tareas deterministas (parsing, clasificación).

Conclusión

El stack mínimo para construir productos inteligentes en 2026 integra Next.js, Supabase y un orquestador como n8n con un router de modelos. No es glamouroso, es eficaz: reduce la deuda operativa y te permite iterar rápido en capacidades de IA útiles. Construye primero la memoria y la orquestación; los modelos son reemplazables, la arquitectura no.

Recursos

Para quienes trabajan en automatización, agentes y workflows, puede ser útil explorar herramientas y experimentos adicionales en Dominicode Labs. Esta referencia funciona como una continuación práctica para validar patrones de orquestación y trazabilidad en productos inteligentes.

FAQ

- ¿Por qué usar Supabase en lugar de un vector store separado?

- ¿Cuándo self-hostear n8n vs usar la versión SaaS?

- ¿Cómo implementar trazabilidad de prompts?

- ¿Qué criterios debe usar el router de modelos?

- ¿Cuál es la práctica recomendada para production temperature?

- ¿Cómo medir la latencia objetivo de RAG?

Respuesta: ¿Por qué usar Supabase en lugar de un vector store separado?

Mantener datos transaccionales y embeddings en la misma base de datos reduce latencia y complejidad de sincronización. Supabase ofrece auth integrada y RLS, lo que simplifica seguridad y control de acceso.

Respuesta: ¿Cuándo self-hostear n8n vs usar la versión SaaS?

Self-host si manejas datos sensibles o requisitos regulatorios; SaaS si necesitas velocidad de prototipado y menor overhead operativo.

Respuesta: ¿Cómo implementar trazabilidad de prompts?

Registra prompts, respuestas, tokens y metadatos en una capa de tracing (ej. LangSmith). Correlaciona con eventos de producto (PostHog) para diagnosticar errores y medir hallucination rate.

Respuesta: ¿Qué criterios debe usar el router de modelos?

Decide por task_type, cost_budget y data_sensitivity. Prioriza latencia y privacidad para tareas críticas, economía para generación masiva y fallback local cuando la sensibilidad lo requiera.

Respuesta: ¿Cuál es la práctica recomendada para production temperature?

Mantén temperature=0 para tareas deterministas (parsing, clasificación). Ajusta solo cuando necesitas creatividad en generación y puedes auditar resultados.

Respuesta: ¿Cómo medir la latencia objetivo de RAG?

Mide desde la petición inicial hasta la respuesta final del LLM incluyendo la búsqueda semántica; el objetivo operativo recomendado en el artículo es <100ms para la etapa RAG (recuperación e indexado de embeddings).

Leave a Reply