Tiempo estimado de lectura: 3 min

- Automatiza tareas de marketing con arquitecturas técnicas usando triggers, LLMs y orquestación (n8n) para producir salidas útiles sin intervención constante del equipo de marketing.

- RAG y embeddings (Supabase + pgvector) permiten clasificar y responder leads con documentación respaldatoria automáticamente.

- Monitoreo y social listening con extracción periódica, filtrado, clustering por embeddings y resúmenes accionables reducen el tiempo de vigilancia manual.

- Safeguards imprescindibles: idempotencia en webhooks, validación (Zod/Pydantic), human‑in‑the‑loop y control de costes (cache de embeddings, modelos pequeños).

Resumen rápido (lectores con prisa)

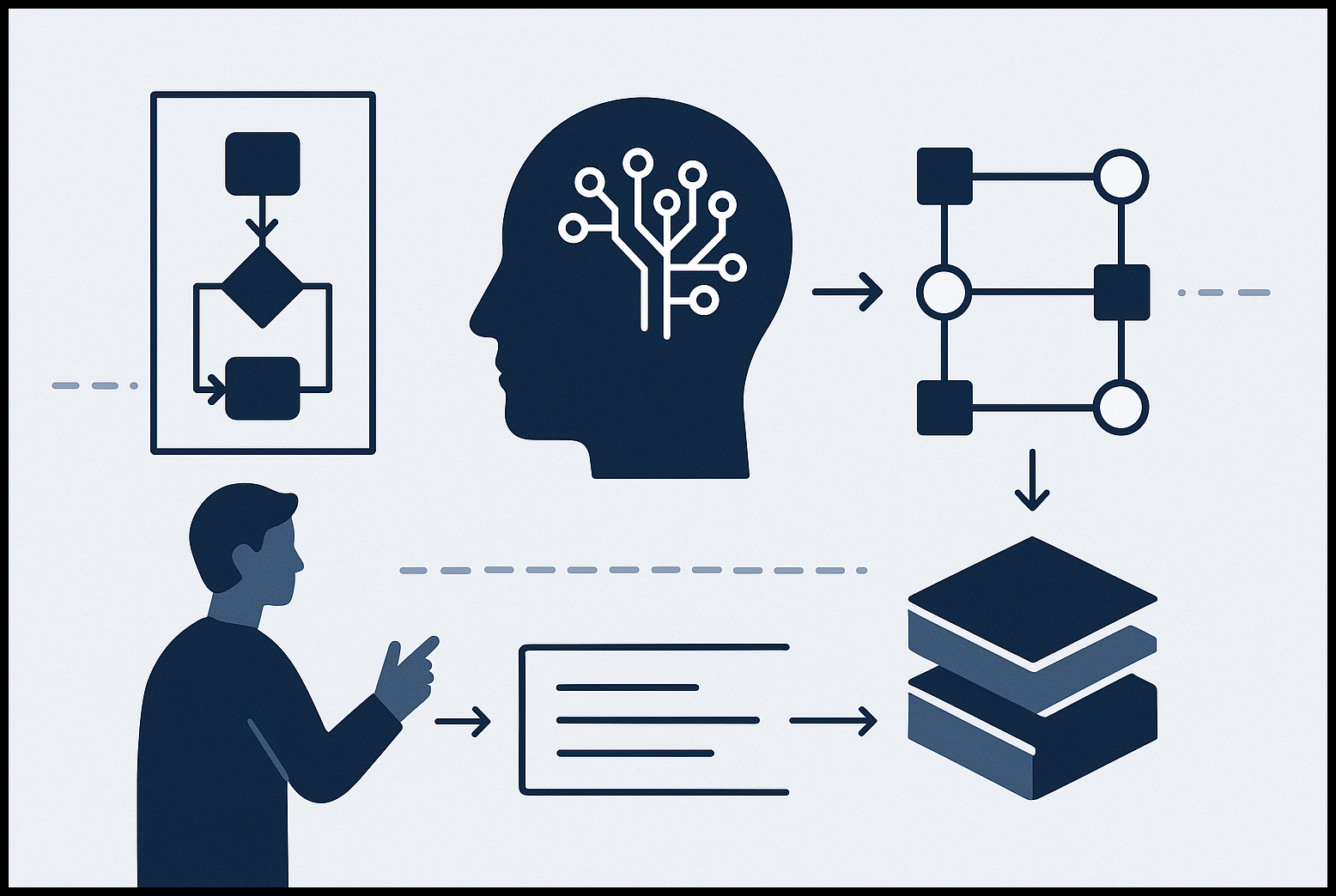

Automatización técnica que convierte eventos (webhooks, formularios, cron jobs) en salidas accionables usando orquestación (n8n), LLMs para transformación y Supabase/pgvector para memoria y retrieval.

Útil cuando quieres documentar releases, clasificar leads técnicamente o monitorizar conversación técnica sin intervención manual constante.

Importa porque traslada trabajo repetitivo a microservicios, liberando horas de engineering y ventas para casos complejos.

Funciona mediante triggers → transformación (LLM/embeddings) → acción (CMS, Slack, CRM, tickets) con guardrails: idempotencia, validación y aprobación humana.

Automatización con IA para no marketers: tres arquitecturas que funcionan

Piensa en esto como construir microservicios: cada flujo tiene un trigger, una transformación y una acción. Usa n8n (orquestación), LLMs para transformación y Supabase/PgVector para memoria cuando haga falta.

Caso 1 — De git push a anuncio técnico (Changelog automático)

El problema: lanzas features y nadie lo sabe. Redactar el changelog es tedioso y se olvida.

Arquitectura mínima:

- Trigger: webhook GitHub (Docs) (release o pull_request con etiqueta

user-facing). - Procesamiento LLM: prompt estructurado que recibe

{pr_title, diff_summary, changelog_entries}. System prompt: “Eres un Technical Writer. Traduce a beneficios de usuario. Salida: Markdown 150–200 palabras.” - Salida multicanal: crea draft en CMS (Ghost/Notion), post en Slack y genera un hilo para Twitter/X (para aprobación).

Implementación práctica: nodo GitHub Webhook → nodo OpenAI/Anthropic → nodos paralelos (CMS API, Slack, DB). Añade un paso de aprobación humana antes de publicar al público.

Beneficio claro: cada release documentado sin que el dev escriba una palabra.

Caso 2 — Triaje técnico de leads con RAG

El problema: ventas te interrumpe para preguntar si una integración es posible. Respondes 20 veces lo mismo.

Arquitectura:

- Ingest: formulario (Typeform/Tally) → webhook.

- Retrieval: convierte la consulta en embedding y busca en la docs indexada en Supabase pgvector. Referencia: https://supabase.com/docs/guides/database/pgvector

- Clasificación LLM: prompt que recibe

<lead_query>y<top_k_chunks>y devuelve JSON con{category: VIABLE|CUSTOM|NO_VIABLE, confidence, justification}. - Acción: actualiza CRM (HubSpot/Pipedrive), crea ticket en Jira si es

CUSTOM.

Resultado: ventas obtiene una clasificación técnica automática y la documentación que respalda la respuesta. El equipo dev solo interviene para casos realmente complejos.

Caso 3 — Social listening técnico sin scroll

El problema: necesitas saber qué dicen de tu stack, pero pasar horas en redes no es opción.

Arquitectura:

- Extracción periódica: cron job en n8n consulta APIs públicas (Reddit, Twitter/X) o RapidAPI si la oficial no es viable. Twitter API docs: Twitter API docs

- Filtrado: pre‑filtro con reglas (regex, puntuación mínima) + modelo pequeño para spam detection.

- Agrupación y resumen: embeddings → clustering → LLM que resume por tema (bugs, feature requests, comparativas).

- Reporte: envío semanal a Slack/Notion con JSON accionable (temas, sentimiento, volumen).

Valor: decisiones de producto basadas en patrones, no en anécdotas.

Stack recomendado (práctico y minimalista)

- Orquestación: n8n (self‑host para privacidad). Docs: https://docs.n8n.io/

- LLMs: OpenAI o Anthropic (usar JSON mode / function calling cuando sea posible). OpenAI Function Calling: OpenAI Function Calling

- RAG/Embeddings: Supabase + pgvector. https://supabase.com/docs/guides/ai

- Storage: PostgreSQL / Supabase para logs y golden datasets.

Safeguards técnicos imprescindibles

- Idempotencia en webhooks: diseñar handlers que toleren re‑envíos.

- Validación de salida: Zod/Pydantic para validar JSON; si falla, retry con prompt corrector (max 2).

- Human‑in‑the‑loop: nodo de “espera” en n8n que publique solo tras aprobación.

- Cost control: cache de embeddings, modelos “mini” para etapas de preprocesado.

Cómo empezar en 2 horas

- Implementa el Case 1 en n8n: webhook GitHub → llamada al LLM → draft en Notion + notificación Slack.

- Mide: tiempo ahorrado y tasa de publicaciones por release.

- Si funciona, integra Case 2 con Supabase pgvector y un endpoint de formulario.

Cierre operativo

Automatización con IA para no marketers no es marketing travestido: es reingeniería de procesos. Empieza pequeño, mide ROI en horas ahorradas o leads calificados, y estabiliza con pruebas automáticas y validadores. Cuando el sistema funcione, volverás a lo que importa: construir buen software, sabiendo que la visibilidad y la toma de decisiones están cubiertas por ingeniería.

Implementa uno de estos flujos hoy. Si lo haces bien, mañana el equipo agradecerá no haber tenido que escribir otro changelog.

Para documentación adicional, plantillas y pruebas conceptuales relacionadas con automatización, orquestación y RAG, considera revisar recursos y experimentos en Dominicode Labs. Es una continuación lógica para validar flujos y patrones mostrados aquí en entornos de laboratorio antes de desplegar en producción.

FAQ

- ¿Qué necesito para poner en marcha el Caso 1?

- ¿Cómo integro Supabase y pgvector en Case 2?

- ¿Qué frecuencia recomiendan para el social listening?

- ¿Cómo asegurar la idempotencia de los webhooks?

- ¿Qué modelos usar para prefiltrado y por qué?

- ¿Cómo medir ROI de estas automatizaciones?

¿Qué necesito para poner en marcha el Caso 1?

Un repositorio en GitHub con webhooks configurados, una instancia de n8n para orquestar el flujo, acceso a un LLM (OpenAI/Anthropic) y APIs del CMS o Notion para crear drafts. Añade un nodo de aprobación humana en n8n antes de publicar públicamente.

¿Cómo integro Supabase y pgvector en Case 2?

Indexa la documentación en Supabase usando pgvector para embeddings. Al recibir una consulta, genera el embedding, ejecuta un vector search en Supabase y pasa los top_k_chunks al LLM para clasificación y justificación.

¿Qué frecuencia recomiendan para el social listening?

Depende del volumen: para proyectos pequeños, cron diario; para proyectos con mucho ruido, múltiples extracciones diarias. Luego agrega un reporte semanal consolidado con temas y sentimiento.

¿Cómo asegurar la idempotencia de los webhooks?

Guarda un identificador único del evento en tu DB al procesarlo. Si llega un re‑envío, verifica si el id ya existe y evita re‑procesarlo. Diseña handlers que sean seguros ante reintentos.

¿Qué modelos usar para prefiltrado y por qué?

Usa modelos pequeños y económicos para spam detection y prefiltrado (latencia baja, coste bajo). Reserva LLMs más grandes para la transformación final y generación de texto cuando el resultado necesita mayor calidad.

¿Cómo medir ROI de estas automatizaciones?

Mide horas ahorradas en tareas repetitivas, tasa de publicaciones por release, tiempo de respuesta a leads y número de tickets reales generados frente a consultas resueltas automáticamente. Estos indicadores muestran impacto directo en productividad y calidad de leads.

Leave a Reply